Pesquisadores de IA do Google propõem uma abordagem geral para geração de texto personalizado usando modelos de linguagem grandes (LLMs)

A tecnologia pode ser uma ferramenta poderosa para melhorar a comunicação, mas é importante garantir que ela seja usada de maneira responsável e transparente

Os modelos de linguagem grandes (LLMs), como aqueles desenvolvidos pela OpenAI e pelo Google, têm demonstrado um incrível potencial na geração de texto. No entanto, um desafio persiste: como gerar texto que seja verdadeiramente personalizado para um determinado usuário ou contexto? Pesquisadores de IA do Google propuseram uma abordagem geral para enfrentar esse desafio.

A abordagem se baseia em dois princípios fundamentais:

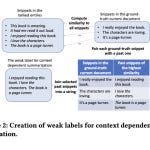

Aprendizado de Regras de Personalização: O modelo é treinado em um conjunto diversificado de exemplos de texto personalizado. Ele aprende a reconhecer as nuances da personalização, como o estilo de escrita e as preferências do usuário.

Geração Controlada por Sinalização: O modelo é condicionado a gerar texto que atenda a um conjunto específico de sinalizadores ou "tags". Esses sinalizadores podem indicar coisas como o tom desejado do texto, o público-alvo e a finalidade.

A combinação desses princípios permite que o modelo gere texto que seja altamente personalizado. Isso é especialmente útil em cenários como chatbots, onde a interação com os usuários exige uma abordagem personalizada para garantir uma experiência mais envolvente.

No entanto, também existem desafios associados a essa abordagem. A personalização excessiva pode levar a resultados não naturais ou a falta de diversidade no texto gerado. Além disso, há preocupações sobre o uso indevido da tecnologia para criar textos que imitam com precisão o estilo de escrita de uma pessoa, levantando questões de autenticidade e confiança.

Como a geração de texto personalizado continua a evoluir, é crucial encontrar um equilíbrio entre a personalização e a ética. A tecnologia pode ser uma ferramenta poderosa para melhorar a comunicação, mas é importante garantir que ela seja usada de maneira responsável e transparente.Ouça também nosso Podcast