Esta equipe do MIT está combatendo a manipulação maliciosa de imagens por IA

O PhotoGuard funciona alterando alguns pixels selecionados em cada imagem de tal maneira que a IA vê coisas que não estão lá.

À medida que a criação e edição de imagens por IA se torna mais prevalente, surge uma nova preocupação com a privacidade digital - a edição não autorizada de uma obra de arte ou imagem de alguém por IA. Até o momento, nada impede que alguém pegue uma imagem online, faça upload para um programa de IA e a manipule para todos os tipos de propósitos.

Mas uma nova técnica de uma equipe do MIT pode mudar isso.

Simplesmente chamado de "PhotoGuard", o método envolve um profundo entendimento dos algoritmos que a IA opera. Com esse entendimento, a equipe desenvolveu maneiras de alterar muito sutilmente uma imagem, interrompendo a forma como a IA a interpreta. E se a IA não consegue entender uma imagem, ela não pode editá-la.

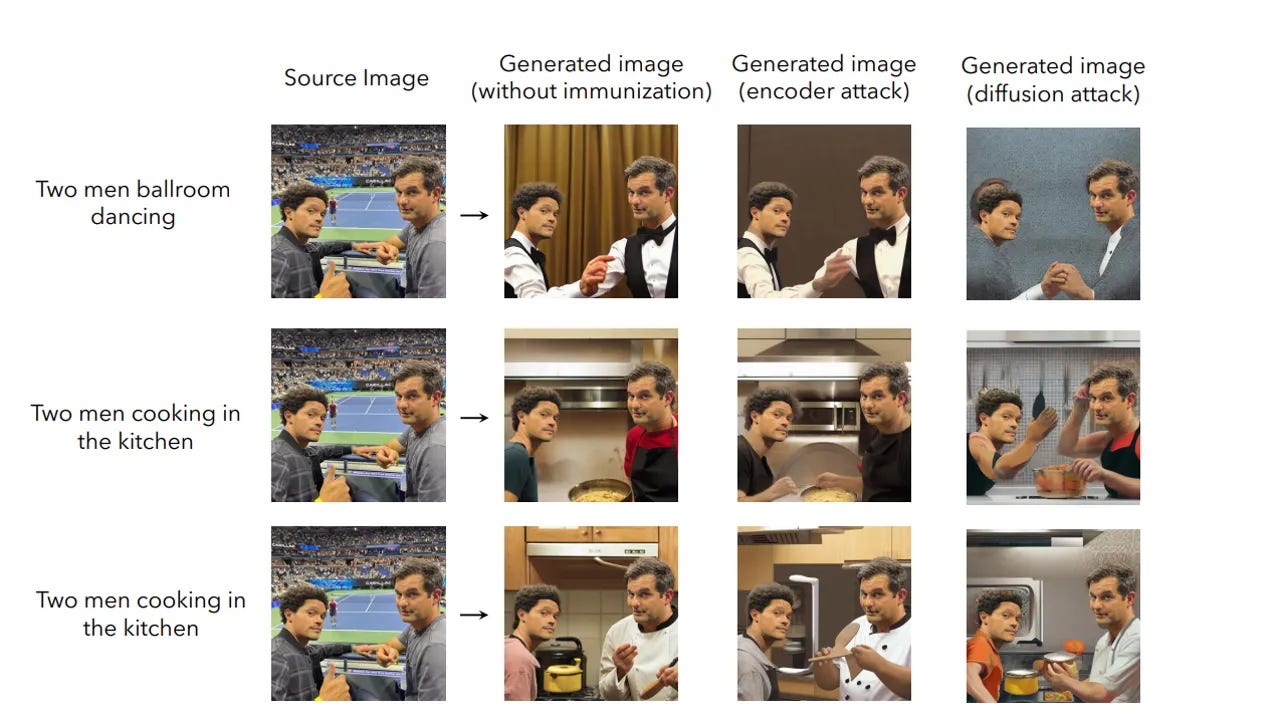

"No cerne de nossa abordagem", explicou a equipe do MIT em um artigo sobre seu projeto, "está a ideia de imunização de imagem - ou seja, tornar uma imagem específica resistente à manipulação alimentada por IA, adicionando uma perturbação cuidadosamente elaborada (imperceptível) a ela."

O PhotoGuard funciona alterando alguns pixels selecionados em cada imagem de tal maneira que a IA vê coisas que não estão lá. Essas mudanças não são visíveis ao olho humano, mas são cegamente brilhantes para a IA. Quando a IA vê os pixels editados, ela superestima sua importância e edita a imagem para esses pixels em vez do resto da imagem.

Para testar seus resultados, a equipe do MIT pegou 60 imagens e gerou edições de IA usando vários prompts - tanto em versões imunizadas quanto não imunizadas da mesma imagem. Uma vez que a nova imagem foi criada, eles usaram várias métricas para determinar quão semelhantes eram as edições. O resultado final? Em um teste de 60 imagens, a equipe descobriu que as edições de imagens imunizadas eram "notavelmente diferentes daquelas de imagens não imunizadas".

Claro, o método não é infalível. Se alguém quisesse muito, ainda poderia editar maliciosamente uma imagem - talvez cortando uma foto até cortar o pixel causando problemas ou simplesmente aplicando um filtro à imagem. Ainda assim, isso apresenta um obstáculo significativo que poderia dissuadir muitas pessoas.

E enquanto este método é eficaz contra esta geração de IA, isso não significa necessariamente que será no futuro. É por isso que os criadores do PhotoGuard incentivam o crescimento nesta área não apenas através de métodos técnicos, mas através da "colaboração entre organizações que desenvolvem grandes modelos de difusão, usuários finais, bem como plataformas de hospedagem e disseminação de dados."

No momento, o PhotoGuard é simplesmente uma técnica. Não há software disponível para o público, e o criador admite que há muito trabalho a ser feito para que isso seja prático e disponível para o público em geral. Ainda assim, este é um passo à frente para se proteger contra novas ameaças da IA, diz a equipe do MIT, e um sinal de que as empresas precisam investir na luta.